DeepSeek

bereit

State-of-the-Art LLM mit exzellenter Kontextverarbeitung und starken Deutsch-Fähigkeiten. Ideal für Chat- und Wissensmodelle.

Text · Größe: 67 B

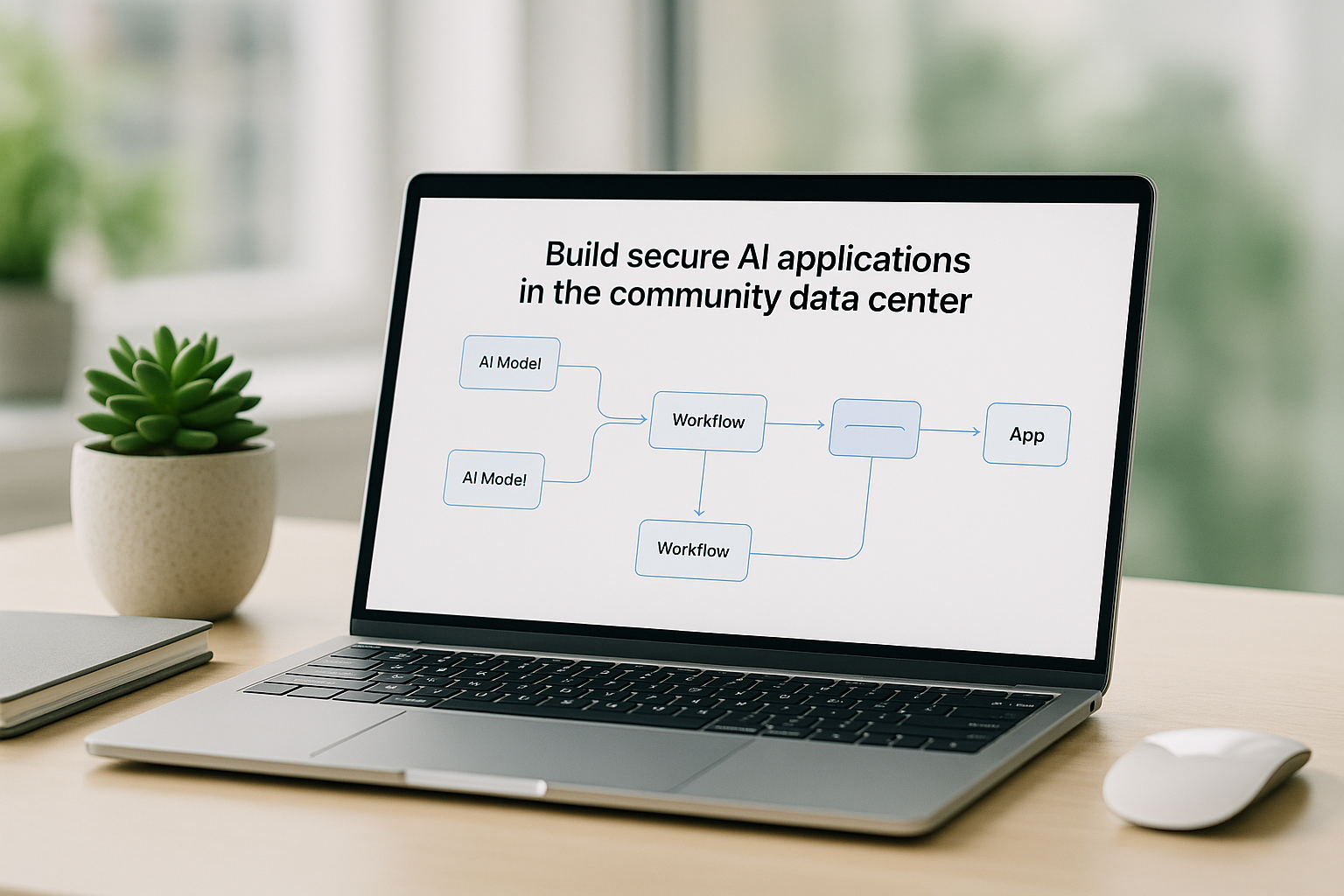

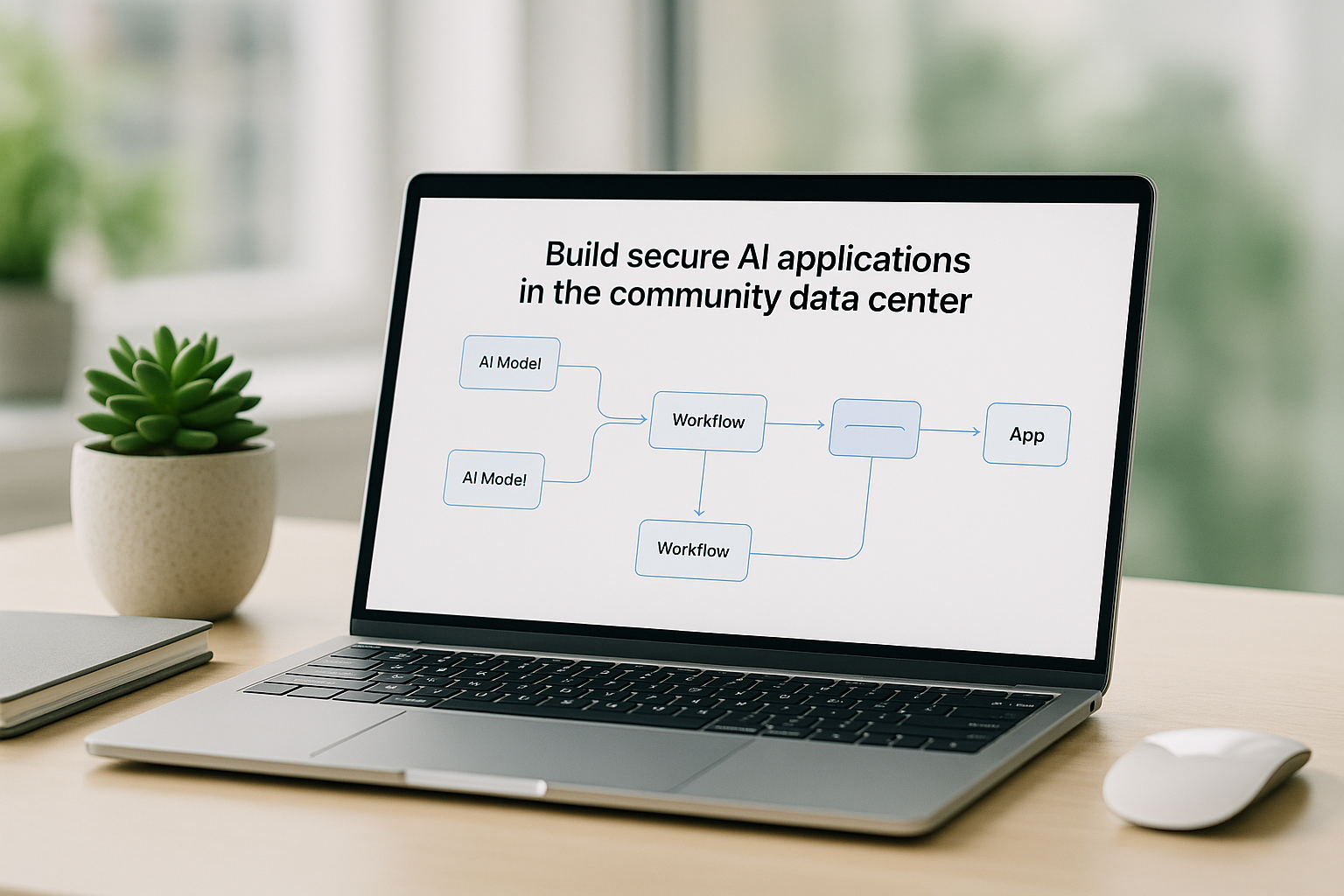

Modellkatalog

Open Source oder eigene Modelle werden zentral registriert, versioniert und auf der GPU-Infrastruktur im Rechenzentrum betrieben.

Diese Modelle stehen auf der DVVKI-Plattform zur Verfügung oder können kurzfristig integriert werden.

bereit

State-of-the-Art LLM mit exzellenter Kontextverarbeitung und starken Deutsch-Fähigkeiten. Ideal für Chat- und Wissensmodelle.

Text · Größe: 67 B

bereit

Aktuelle Meta-Generation mit hoher Effizienz, ideal für produktive Chat-Anwendungen und interne Assistenten.

Text · Größe: 70 B / 405 B Varianten

bereit

Open-Source LLM von Alibaba mit herausragendem Sprachverständnis für europäische Sprachen. Sehr performantes Allround-Modell.

Text · 32 B / 72 B

bereit

Extrem leistungsfähiges reasoning-Modell, besonders stark in Analyse- und Planungsaufgaben.

Text · 32 B

bereit

Leichtes, multimodales Modell mit Fokus auf Geschwindigkeit und niedrigem GPU-Verbrauch. Für Edge-Deployment optimiert.

Text / Vision

bereit

Spezialisiertes Modell für Python, PowerShell und Infrastrukturcode. Unterstützt Autovervollständigung und Fehlersuche.

Code · 30 B

bereit

Effizient und schnell. Perfekt für kompakte Assistenten und On-Prem Chatbots.

Text · 7 B

bereit

Multimodales Modell für Bildinterpretation. Erkennt Objekte und kann Szenen beschreiben.

Vision + Text

bereit

Bildgenerierung aus Text-Prompts. Alle Berechnungen laufen auf der eigenen GPU.

Vision

Wir unterstützen die Einbindung weiterer Open-Source-Modelle sowie proprietärer Modelle über Container- oder API-Schnittstellen.